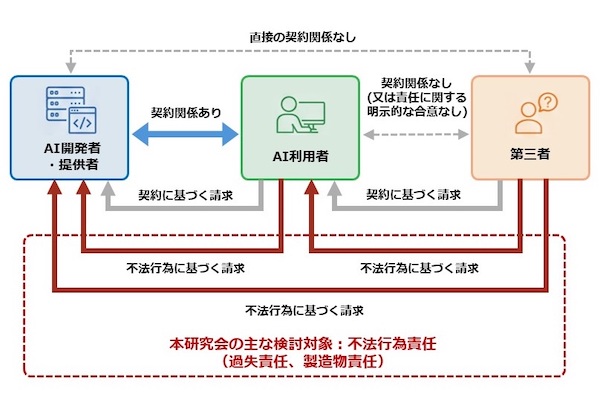

経済産業省は4月9日、AIの利活用によって第三者に損害が生じた場合の民事責任について、現行法に基づく解釈の方向性を整理した「AI利活用における民事責任の解釈適用に関する手引き〔第1.0版〕」を公表した。AIの開発者、提供者、利用者それぞれの責任範囲に関する予見可能性を高め、AI活用の促進と紛争の円滑な解決につなげる狙いがある。

背景には、生成AIの普及により企業でのAI活用が急速に広がる一方、ブラックボックス性や自律性の高さから、損害発生時の責任の所在が不明確であることが導入の障壁となっていた点がある。同省は、法学・技術分野の有識者による研究会での議論や意見公募を経て、手引きを取りまとめた。

手引きは、第三者に損害が発生した事案を想定、不法行為責任を中心に、製造物責任法も視野に入れて整理している。契約責任を直接の対象とするものではないが、当事者間で責任分担を設計する際の前提となる“デフォルトルール”を示す位置付けだ。

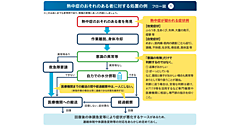

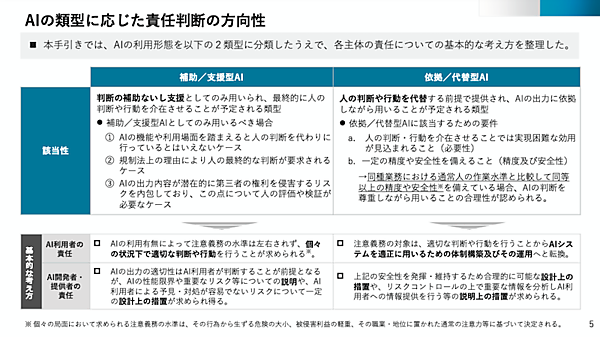

AIの利用形態を「補助/支援型AI」と「依拠/代替型AI」に整理

大きな特長は、AIの利用形態を「補助/支援型AI」と「依拠/代替型AI」の2類型に整理した点にある。

「補助/支援型AI」は、人の判断を補助する用途を想定したもので、最終判断は人が担う。この場合、AIを利用していても、利用者は自身の職務や立場に応じた注意義務を引き続き負う。AIの出力をそのまま採用した場合、責任が軽減されるわけではなく、内容の妥当性を検証することが求められる。一方、開発者・提供者には、機能や限界、想定されるリスクについて適切な情報提供が要請される。

これに対し「依拠/代替型AI」は、人の判断や行動を代替する前提で利用されるもの。この場合、利用者の注意義務は、AIシステムを適切に運用するための体制整備や管理に重点が置かれる。開発者・提供者には、安全性確保のための設計や、リスク管理に必要な情報提供などが求められる。

具体的な参考例として画像生成AIやAIエージェントにおける事例を掲載

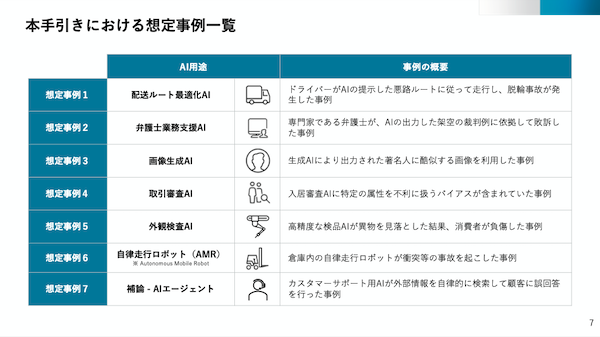

具体的な判断の参考として、配送ルート最適化AI(補助/支援型AI)、弁護士業務支援(AI補助/支援型AI)、画像生成AI(AI補助/支援型AI)、取引審査AI(AI補助/支援型AI)、外観検査AI(依拠/代替型AI)、自律走行ロボット(AMR)(依拠/代替型AI)などの想定事例を掲載。補論ではAIエージェントにも触れ、現時点では2類型いずれかの一律の責任整理は難しいとしつつも、今回の2類型の枠組みが基礎になるとした。

たとえば、画像生成AIを用いた広告制作のケースでは、生成物を十分に確認せず公開した結果、第三者の著作権や肖像権などを侵害した場合、AI開発会社が、著名人と同一または類似の肖像が高頻度で生成されるAIを意図的に開発・販売していたといった事情がない限り、利用者側の注意義務違反が問われる可能性があると整理。最終的な公開判断を人が担う以上、出力内容の確認責任が重視される。

また、立証や手続面にも言及している点は実務上のポイント。AI関連事案では、技術的な専門性や証拠の偏在により、被害者側の立証が困難となる可能性がある。このため、文書提出命令など既存制度の活用に加え、場合によっては過失や欠陥の事実上の推定が問題となり得ることにも触れている。

経済産業省は、本手引きについて新たな責任法制を設けるものではなく、あくまで現行法の解釈適用の方向性を示したものと位置付ける。AI活用の拡大に伴い不透明だった責任の考え方に一定の指針を示したことで、企業のAI導入やガバナンス整備を後押しする資料となりそうだ。